Ricardo Baeza-Yates

«Cualquier nueva aplicación de IA debe demostrar que su uso producirá más beneficio que daño»

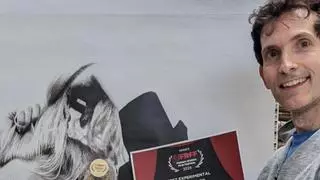

El ingeniero Ricardo Baeza-Yates. | ALEX DOMÍNGUEZ / redacción

El desarrollo de la Inteligencia Artificial debe llevar en paralelo una evolución de normas precisas y éticamente adecuadas para establecer su control. El ingeniero chileno Ricardo Baeza-Yates es director de investigación en el Instituto de IA Experiencial de la Northeastern University, del Silicon Valley Campus. Está especializado en lo que se ha dado en llamar «IA responsable», un enfoque que pretende facilitar que la evolución de esta tecnología se produzca de manera confiable, segura y ética. Baeza-Yates será el primer conferenciante del II Forum Europeo de Inteligencia Artificial que se celebrará este miércoles en el ADDA, que organizan y promueven Encuentros NOW, Ellis Alicante, Prensa Ibérica e INFORMACIÓN.

¿Por qué hay aún tanta gente a la que todo lo relacionado con la inteligencia artificial le causa aún tanta inquietud? ¿Es un efecto parecido a las reacciones negativas que provocaron las anteriores «revoluciones industriales» a las que se compara la llegada de la IA?

Es una pregunta difícil pues hay muchos factores involucrados. Primero, mucha gente no entiende que es la IA y la reacción natural que tenemos a lo desconocido es temor. Segundo, el mensaje negativo que algunas personas muy influyentes en IA están enviando, tampoco ayuda, pues la IA general aún no existe e incluso si existiera (falta mucho para eso) el peligro debiera estar bajo control. Finalmente, en algunos casos incluso este mensaje puede ser sólo una cortina de humo para los problemas que tenemos hoy mismo como falta de transparencia y discriminación automatizada que afectan a muchas personas ya sea física o mentalmente (y nuestra salud mental es para mí el peligro inmediato más importante).

¿Crees que está cambiando la percepción negativa o neutra que mucha gente tiene de la IA y que ésta se está convirtiendo en positiva?

No lo sé, nuestra precepción de lo que cree la gente puede estar engañada por la amplificación de las redes sociales o nuestras burbujas culturales.

¿Qué principios y normas deberían regir el desarrollo y el uso de la inteligencia artificial para garantizar su responsabilidad, transparencia, equidad y respeto a los derechos humanos?

Hay muchas propuestas de principios instrumentales, como las de la UNESCO o la OCDE, pero prefiero los de ACM publicados en octubre del 2022 donde yo fui uno de los dos autores principales. Estos nueve principios comienzan con uno que yo propuse: legitimidad y competencia. Es decir, cualquier nueva aplicación debe mostrar que su uso es mucho más beneficioso que los posibles daños que puede provocar y que se poseen todas las competencias administrativas y técnicas para llevarla a cabo con éxito.

¿Qué límites éticos y legales deberían tener las investigaciones y experimentos con la inteligencia artificial, especialmente cuando involucran a seres humanos o animales?

Aplicaciones que no tienen una base científica clara o no son legítimas, como comento en la respuesta anterior, debieran estar prohibidas. Por ejemplo, hoy se supone que datos de otras personas pueden ser usados para predecir mi comportamiento (por ejemplo, que devolveré un préstamo bancario). Esto puede que sea cierto en promedio, pero cada persona es distinta y al usar el promedio estamos discriminando a muchas personas.

¿Cómo se puede evitar el sesgo de género en la IA?

Nunca se puede evitar, pero se puede mitigar analizando los datos, los algoritmos y analizando las interacciones entre los sistemas de IA y las personas. También ayuda tener mecanismos para que las personas pueden retroalimentar a los sistemas y advertir de posibles discriminaciones (el sesgo de género no siempre es negativo).

¿Cómo se puede compatibilizar la protección de datos con la IA?

Siempre hay que anonimizar los datos agrupándolos de modo que no sea posible inferir valores individuales y/o usar técnicas avanzadas como privacidad diferencial, que agregan aleatoriedad a los mismos.

¿Hay que formar y educar en IA para evitar casos como el de la difusión de imágenes de personas desnudas tratadas por la IA?

Hay que formar y educar a las personas para todo. La IA es una tecnología más, que lamentablemente facilita este tipo de acciones. Es una lástima que materias como la filosofía, que incluye la ética, o la educación cívica, ya no sean importantes, pues eso ayuda a que la gente no entienda el daño con este tipo de abusos.

¿Qué impacto tiene la inteligencia artificial en nuestra cultura, nuestra identidad, nuestra comunicación y nuestra forma de pensar y aprender? ¿Nos hace más inteligentes o nos hace más dependientes?

Sin contar el impacto en nuestra salud mental (ya ha habido un suicidio y ya hay muchas personas conversando con “deadbots” – modelos especializados en personas que ya han fallecido), nos hace más dependientes. ¿Cuántas personas pueden encontrar una dirección sin el GPS? ¿Cuántas son adictas a estos dispositivos cambiando nuestra educación cívica e interacciones sociales? ¿Cuántas podrán escribir una carta en cinco años?

¿Estaremos dominados algún día por la IA?

No lo creo, el peligro más inmediato es que un grupo de seres humanos use la IA para dominar a otro grupo de seres humanos. Esto ya ha pasado con otras tecnologías. Las armas de metal se usaron para conquistar otras tribus y las armas de fuego se usaron para esclavizar personas, por mencionar sólo dos ejemplos.

- Oportunidad única en Benidorm: un piso de 150 metros cuadrados con vistas al mar por 255.000 euros

- La sorprendente decisión del BCE que afecta a las hipotecas: esto ha pasado con los tipos de interés en julio

- Desalojan del Ayuntamiento de Alicante una protesta por la falta de vivienda para un niño de 6 años con parálisis cerebral

- El concejal de Cultura de Vox aprueba una subvención de 12.020 euros para el Premio Internacional de Poesía Miguel Hernández

- Paralizan en Alicante hasta Nochevieja el desahucio de una mujer y su hija de 22 años encamada

- Los vecinos de Orihuela Costa le dan un repaso al alcalde Vegara en el pleno por el incumplimento de sus promesas

- ¿Qué son las salpas, la nueva plaga que está apareciendo en varias playas españolas?

- Día histórico en Arenales: abre el reivindicado centro social que será eficiente y con tecnología punta